En gelişmiş algoritmaların yaptıkları şeyi nasıl yaptıklarını gerçekten bilen hiç kimse yok. Bu durum başımıza iş açabilir.

2016 yılında, New Jersey'in Monmouth İlçesi'ndeki sessiz yollara kendi kendini süren tuhaf bir araba çıkarıldı. Yonga üreticisi Nvidia'daki araştırmacıların geliştirdiği bu deneysel vasıta, diğer özerk arabalardan farklı görünmüyordu; ancak Google, Tesla veya General Motors'un tanıttığı şeylerden farklıydı ve yapay zekânın yükselen gücünü göstermişti. Araba, bir mühendis veya programcının sağladığı bir tek talimatı bile izlememişti. Bunun yerine tamamen, araba süren bir insanı izleyerek kendine sürmeyi öğrenmesini sağlayan bir algoritmaya dayanıyordu.

Bir arabanın bu şekilde kendi kendini kullanmasını sağlamak etkileyici bir başarıydı. Fakat, arabanın kendi kararlarını nasıl verdiği tamamen belli olmadığından, aynı zamanda biraz tedirgin ediciydi. Aracın algılayıcılarından gelen bilgiler doğrudan, veriyi işleyen ve daha sonra direksiyonu, frenleri ve diğer yapıları işletmek için gereken emirleri ulaştıran devasa bir yapay sinir ağına gidiyordu. Sonuçlar, bir insan sürücüden bekleyebileceğiniz tepkilerle uyuşuyor gibi görünüyor. Fakat ya günün birinde beklenmedik bir şey yaparsa; bir ağaca çarpar veya yeşil ışıkta durursa? Şu anki duruma göre, bunun sebebini bulmak zor olabilir. Sistem o kadar karmaşık ki, onu tasarlayan mühendisler bile herhangi bir eylemin sebebini tam olarak belirlemekte zorlanabilir. Üstelik bunu soramazsınız da; yaptığı şeyi neden o şekilde yaptığını her zaman açıklayabilen böylesi bir sistem tasarlamanın belirgin bir yolu yok.

Bu aracın gizemli zihni, yapay zekânın belli belirsiz görünen bir meselesine işaret ediyor. Arabanın temelinde yer alan ve derin öğrenme olarak bilinen yapay zekâ teknolojisinin, son yıllarda sorun çözme konusunda çok güçlü olduğu kanıtlandı ve bu teknoloji görüntü içeriğini tahmin etme, ses tanıma ve dil tercümesi gibi işlerde geniş ölçüde uygulandı. Şimdi aynı yöntemlerin bütün endüstrileri değiştirmek için ölümcül hastalıkları teşhis etmek, milyon dolarlık ticari kararlar vermek vb. gibi sayısız şey yapabileceğine dair umutlar var.

Fakat derin öğrenme gibi yöntemleri, kendi yaratıcıları için daha anlaşılabilir ve kullanıcıları için daha güvenilir hale getirmek amacıyla yeni yöntemler bulmadıkça bu durum gerçekleşmeyecek; daha doğrusu gerçekleşmemeli. Yoksa, başarısızlıkların ne zaman meydana gelebileceğini tahmin etmek zor olacaktır ve meydana gelmeleri kaçınılmazdır. Nvidia'nın arabasının hâlâ "deneysel" olmasının sebeplerinden biri de zaten bu.

Halihazırda, kimin şartlı tahliye olacağını, kimin borç para almak için onaylanacağını ve kimin işe alınacağını belirlemeye yardımcı olması için matematiksel modeller kullanılıyor. Eğer bu matematiksel modellere erişim sağlayabiliyorsanız, bunların muhakemesini anlamak mümkün olur. Fakat bankalar, ordu, işverenler ve diğerleri artık dikkatlerini daha karmaşık makine öğrenimi yaklaşımlarına yöneltiyor. Bu yaklaşımlar, otomatikleştirilmiş karar vermeyi hepten anlaşılmaz hale getirebiliyor. Bu yaklaşımların en yaygın olanı derin öğrenme, bilgisayarları programlama konusunda esasen farklı bir yolu temsil ediyor. Makine öğrenimi uygulamaları üzerinde çalışan bir MIT profesörü olan Tommi Jaakkola şöyle söylüyor: "Bu halihazırda konuyla ilgili bir sorun ve gelecekte çok daha ilgili hale gelecek. Bu ister bir yatırım kararı ya da tıbbi bir karar olsun, ister askerî bir karar olsun, sadece bir 'kara kutu' yöntemine bel bağlamak istemezsiniz."

Bir yapay zekâ sistemini, vardığı sonuçlara nasıl vardığı hakkında sorgulayabilmenin esas bir yasal hak olduğuna dair halihazırda bir tartışma mevcut. Avrupa Birliği, 2018 yılının yazından başlayarak, şirketlerin kullanıcılara otomatikleşmiş sistemlerin vardığı kararlar hakkında bir açıklama sağlayabilmesini zorunlu tutabilir. Bu durum, reklam veya şarkı önerileri sunmak amacıyla derin öğrenme kullanan uygulamalar ile internet siteleri gibi, yüzeyde nispeten basit görünen sistemler için bile imkansız olabilir. Bu hizmetleri yürüten bilgisayarlar kendi kendilerini programlamışlardır ve bunu, bizim anlayamadığımız şekillerde yapmışlardır. Bu uygulamaları inşa eden mühendisler bile onların davranışlarını tam olarak açıklayamıyor.

Bu durum, kafa kurcalayan sorular doğuruyor. Teknoloji ilerledikçe, yakın zaman içinde yapay zekâ kullanmanın bir inanç sıçraması gerektirdiği bazı eşiklerin ötesine geçebiliriz. Biz insanlar elbette kendi düşünce süreçlerimizi de her zaman tam manasıyla açıklayamıyoruz; ancak insanlara sezgisel olarak güvenmek ve onları ölçmek için çeşitli yöntemler buluyoruz. Bu durum, bir insanın yaptığından farklı şekilde düşünen ve kararlar veren makineler için de mümkün olacak mı? Daha önce üreticilerinin anlamadığı şekillerde işleyen makineleri hiç inşa etmemiştik. Tahmin edilemez veya anlaşılmaz olabilen zeki makinelerle iletişim kurmayı (ve onlarla anlaşmayı) ne kadar umabiliriz? Bu sorular, Google'dan Apple'a ve bunların arasında bulunan, zamanımızın en büyük düşünürlerinden biriyle bir görüşmenin de bulunduğu pek çok yere kadar, yapay zekâ algoritmaları üzerinde yapılan yeni teknoloji araştırmalarına doğru bir yolculuğa çıkarıyor.

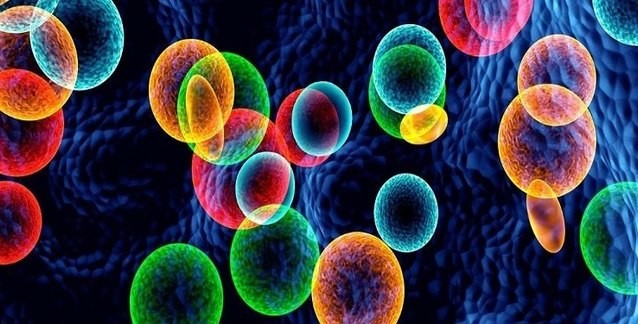

Sanatçı Adam Ferriss, derin bir sinir ağının doku tanıma yeteneklerini teşvik etmek amacıyla bir görüntü ayarlayan program olan Google Deep Dream'i kullanarak bu görüntüyü ve aşağıdakini oluşturdu. Görüntüler, orta seviye sinir ağı katmanı kullanılarak oluşturuldu.

Sanatçı Adam Ferriss, derin bir sinir ağının doku tanıma yeteneklerini teşvik etmek amacıyla bir görüntü ayarlayan program olan Google Deep Dream'i kullanarak bu görüntüyü ve aşağıdakini oluşturdu. Görüntüler, orta seviye sinir ağı katmanı kullanılarak oluşturuldu.2015 yılında, New York'taki Mount Sinai Hastanesi'ndeki bir araştırma grubu, hastanenin devasa hasta kaydı veritabanına derin öğrenme uygulamak istedi. Bu veri dizisi, hastalar hakkında onların test sonuçlarından, doktor ziyaretlerinden vb. yararlanan binlerce değişken sunuyor. Bunun sonucunda ortaya çıkan ve araştırmacıların Deep Patient olarak adlandırdığı program, yaklaşık 700.000 bireyin verisi kullanılarak eğitildi ve yeni kayıtlar üzerinde test edildiği zaman, hastalık tahmin etmede inanılmaz derecede iyi olduğunu gösterdi. Deep Patient, herhangi bir uzman talimatı olmadan, hastane verisinde içinde karaciğer kanserinin de bulunduğu geniş bir hastalık aralığına doğru giden insanları gösterdiği görülen gizli desenleri keşfetti. Mount Sinai takımına önderlik eden Joel Dudley, bir hastanın kayıtlarından hastalığı tahmin etme konusunda "epey iyi" olan birçok yöntem olduğunu söylüyor. Fakat, "bu çok daha iyi," diye ekliyor.

Aynı zamanda Deep Patient biraz kafa karıştırıcı. Şizofreni gibi psikiyatrik hastalıkların başlangıcını, şaşırtıcı derecede iyi şekilde tahmin ettiği görülüyor. Fakat hekimlerin şizofreniyi tahmin etmesi, maalesef bilindiği gibi zor olduğundan, Dudley bunun nasıl mümkün olduğunu merak etmiş. Hâlâ bilmiyor. Yeni araç, bunu nasıl yaptığı konusunda hiçbir ipucu sunmuyor. Eğer Deep Patient gibi bir şey doktorlara gerçekten yardım edecekse, mesela birine reçete olarak yazılan ilaçlarda yapılan bir değişikliğin doğru ve haklı olduğu güvencesini vermek amacıyla, yaptığı tahmin için ideal olarak mantıklı bir açıklama vermeli. Dudley, acıklı şekilde "Bu modelleri inşa edebiliyoruz," diyor, "fakat onların nasıl çalıştığını bilmiyoruz."

Yapay zekâ her zaman bu şekilde değildi. Başlangıçta, yapay zekânın ne şekilde anlaşılabilir veya açıklanabilir olacağı konusunda iki düşünce ekolü bulunuyordu. Pek çokları, kurallar ve mantığa göre düşünülüp kararlaştırılmış makineler üretmenin en mantıklı olduğunu ve bu sayede makinelerin iç işleyişlerinin, kodları denetlemekle ilgilenen kişilere karşı şeffaf hale geleceğini düşünmüştü. Diğerleri, eğer makineler biyolojiden ilham alırsa ve gözlemleyip deneyimleyerek öğrenirse, zekânın daha kolay ortaya çıkacağını düşünmüştü. Bu durum, bilgisayar programcılığını tamamen değiştirmek anlamına geliyordu. Bir programcının bir sorunu çözmek amacıyla emir yazması yerine, program örnek veriye ve istenen bir çıktıya dayalı olarak kendi algoritmasını üretiyor. Sonradan bugünün en güçlü yapay zekâ yapılarına evrimleşecek olan makine öğrenim yöntemleri, ikinci yolu takip etti: makinenin aslında kendi kendini programlamasını.

Bu yaklaşımın uygulamalı kullanımı ilk önceleri sınırlıydı ve 1960'lar ile 70'lerde geniş oranda alanın uzak kısımlarına hapsolmuştu. Ardından, pek çok endüstrinin bilgisayar ile kontrol edilmesi ve büyük veri dizilerinin ortaya çıkışı, bu konuya olan ilgiyi tazeledi. Bu durum, özellikle yapay sinirsel ağ olarak bilinen türün yeni örnekleri olmak üzere, daha güçlü makine öğrenimi yöntemlerinin geliştirilmesine ilham verdi. 1990'lı yıllar itibariyle sinirsel ağlar el ile yazılmış karakterleri kendiliğinden sayısallaştırabiliyordu.

Fakat çok geniş (veya "derin") sinirsel ağlar, zekice yapılan birkaç düzeltme ve geliştirmeden sonra otomatikleştirilmiş algılama konusunda son on yıla dek çarpıcı ilerlemeler göstermemişti. Derin öğrenme, günümüzün yapay zekâ patlamasından sorumlu. Bilgisayarlara, neredeyse bir insanın yapabileceği kadar iyi şekilde konuşulan kelimeleri tanıma yeteneği gibi sıradışı güçler sağladı. Bu beceriyi makineye el ile kodlamak çok karmaşık olurdu. Derin öğrenme, bilgisayar görüşünü dönüştürdü ve makine tercümesini çarpıcı şekilde ilerletti. Artık tıp, ekonomi, üretim alanlarında ve ötesinde her türden kilit kararlara rehberlik etmesi için kullanılıyor.

Adam Ferriss

Adam FerrissMakine öğrenimi teknolojilerinin işleyişi, bilgisayar bilimcileri için bile el ile kodlanan bir sistemden doğal olarak daha anlaşılmazdır. Bu durum, gelecekteki tüm yapay zekâ yöntemlerinin aynı derecede bilinmez olacağı anlamına gelmiyor. Fakat doğası gereği derin öğrenme özellikle karanlık bir kara kutu durumunda.

Derin sinirsel ağın sadece içine bakarak nasıl çalıştığını göremezsiniz. Bir ağın muhakemesi, birbirine karışık şekilde bağlanmış onlarca hatta yüzlerce katmana dizilmiş olan ve taklit edilen binlerce sinirin davranışında gömülü haldedir. İlk katmandaki sinirlerin her biri, bir görüntüde bulunan bir pikselin gerilimi gibi bir girdi alır ve daha sonra çıktı olarak yeni bir sinyal göndermeden önce bir hesaplama gerçekleştirir. Bu çıktılar, karmaşık bir ağda bir sonraki katmana gönderiliyor ve bu işlem, genel bir çıktı üretilene kadar böyle devam ediyor. Ayrıca, geri yayma olarak bilinen ve tekil sinirlerin yaptığı hesaplamaları, bir ağın istenen bir çıktı üretmesini öğreneceği şekilde değiştiren bir işlem bulunuyor.

Derin bir ağdaki pek çok katman, onun farklı soyutlama seviyelerindeki şeyleri tanımasına olanak sağlıyor. Örneğin köpekleri tanıması için tasarlanmış bir yapıda, daha altta bulunan katmanlar ana hatlar veya renk gibi basit şeyleri tanıyor; daha üstte bulunan katmanlar kürk veya gözler gibi daha karmaşık şeyleri tanıyor ve en tepede bulunan katmanlar ise bunların hepsini bir köpek olarak tanımlıyor. Tahminî olarak konuşursak aynı yaklaşım, bir makinenin kendi kendisine öğretmesine yol açan diğer girdilere de uygulanabilir: mesela konuşmadaki kelimeleri oluşturan seslere, metindeki cümleleri oluşturan harflere ve kelimelere veya araç sürmek için gereken direksiyon hareketlerine.

Bu gibi yapılarda neler olduğunu yakalamaya çalışmak ve böylece daha detaylı şekilde açıklamak için ustaca yapılmış taktikler kullanıldı. 2015 yılında Google'daki araştırmacılar, derin öğrenmeye dayalı olan bir görüntü tanıma algoritmasında değişiklik yaptılar ve böylece fotoğraflardaki nesneleri saptamak yerine, onları oluşturacak ve düzenleyecekti. Algoritmayı ters yönde etkili bir şekilde çalıştırarak, mesela programın bir kuş veya binayı tanımak için kullandığı özellikleri keşfedebileceklerdi. Deep Dream (Derin Rüya) olarak bilinen bir projenin ürettiği sonuç görüntüler, bulutlar ve bitkilerden doğan acayip, uzaylı benzeri hayvanları ve ormanlar ile dağ sıraları boyunca serpilen halüsinojen uzakdoğu tapınaklarını gösterdi. Bu görüntüler, derin öğrenmenin tamamen anlaşılamaz olması gerekmediğini ortaya koydu; algoritmaların, bir kuşun gagası veya tüyleri gibi benzer görsel özelliklere hedeflenebileceğini ortaya çıkardı. Fakat görüntüler ayrıca, derin öğrenmenin insanların algısından ne kadar farklı olduğunu, bizim görmezden gelecek olduğumuz insan yapımı bir nesneden bir şey üretebileceğini de ima etti. Google araştırmacıları, bu algoritma bir halterin resimlerini oluşturduğu zaman, onu tutan bir insan kolunu da oluşturduğunu farkettiler. Makine, bir kolun o nesnenin parçası olduğu sonucuna varmıştı.

Sinirbilim ve algı bilimden alınan fikirler kullanılarak daha fazla ilerleme kaydedildi. Wyoming Üniversitesi'nde bir doçent olan Jeff Clune önderliğindeki bir takım, derin sinir ağlarını sınamak amacıyla optik yanılsamalara karşılık gelen bir yapay zekâ görevlendirdi. Clune'un takımı 2015 yılında belirli görüntüler kullanarak sistemin aradığı düşük seviyedeki desenleri kullanıp, bu gibi bir ağı nasıl kandırabileceklerini ve nesnelerin orada olmadığını düşünmesine yol açabileceklerini gösterdi. Clune'a katkıda bulunanlardan biri olan Jason Yosinski de, beyne takılan bir sonda gibi davranan araç oluşturdu. Yaptığı araç, ağın ortasındaki herhangi bir siniri hedef alıyor ve onu en fazla faaliyete geçiren görüntüyü arıyordu. Bulunan görüntüler soyuttu (bir flamingo veya bir okul otobüsüne izlenimci bir bakış hayal edin) ve makinenin algısal yeteneklerinin gizemli doğasına dikkat çekiyordu.

New York Buffalo'daki Cornell Havacılık Laboratuvarında yaklaşık 1960'lardaki ilk yapay sinir ağlarından biri olan bu ağ, ışık algılayıcılarından gelen girdileri işliyordu.

New York Buffalo'daki Cornell Havacılık Laboratuvarında yaklaşık 1960'lardaki ilk yapay sinir ağlarından biri olan bu ağ, ışık algılayıcılarından gelen girdileri işliyordu.Yapay zekânın düşünce şekline göz atmaktan daha fazlasına ihtiyacımız var, ancak ortada kolay bir çözüm yok. Derin bir sinirsel ağın içindeki hesaplamaların birbirleriyle olan etkileşimleri, daha yüksek desen tanıma ve karmaşık karar verme için çok önemli olan şeyler, ancak bu hesaplamalar, matematik işlevlerin ve değişkenlerin bir bataklığı niteliğinde. Jaakkola şöyle aktarıyor: "Eğer çok küçük bir sinir ağınız olsaydı onu anlayabilirdiniz. Fakat çok büyük bir hale geldiğinde ve katman başına binlerce üniteye ve belki de binlerce katmana sahip olduğu zaman, çok ama çok anlaşılmaz hale geliyor."

Jaakkola'ya komşu büroda, makine öğrenimini tıbba uygulamaya kararlı olan MIT profesörü Regina Barzilay var. Kendisine birkaç yıl önce 43 yaşında iken meme kanseri teşhisi konulmuş. Teşhis kendi başına sarsıcıymış, fakat Barzilay son teknoloji istatistik ve makine öğrenim yöntemlerinin kanser araştırmasına yardımcı olması veya hasta tedavisini yönlendirmesi için kullanılmadığını gördüğü zaman bir kez daha dehşete düşmüş. Kendisi, yapay zekânın tıpta devrim yapma konusunda büyük potansiyele sahip olduğunu, fakat bu potansiyelin farkına varmanın, salt tıbbi kayıtların ötesine gitmek anlamına geleceğini söylüyor. Şu an yeterince kullanılmadığını söylediği ham verinin daha fazla kullanılmasını hayal ediyor: "görüntüleme verisi, patoloji verisi, bütün bu bilgiler."

Önceden bilinemeyen ve anlaşılamayan bu makinelerle ne kadar iyi anlaşacağız?

Geçen sene kanser tedavisi bittikten sonra Barzilay ve öğrencileri, araştırmacıların üzerinde çalışmak isteyebileceği belirli klinik özelliklere sahip hastaları belirlemek amacıyla patoloji raporlarında veri madenciliği yapabilen bir sistem geliştirmek için Massachusetts Genel Hastanesi'nde bulunan doktorlarla birlikte çalışmaya başladılar. Ancak Barzilay, sistemin kendi düşüncesini açıklaması gerekeceğini anlamış. Bu yüzden, Jaakkola ve bir öğrencisiyle birlikte bir aşama eklemiş: sistem, keşfettiği bir deseni temsil eden metin parçalarını alıp onları vurguluyor. Barzilay ve öğrencileri ayrıca mamogram görüntülerinde meme kanserinin ilk işaretlerini bulabilen bir derin öğrenme algoritması da geliştiriyorlar ve bu sisteme de vardığı kararı açıklayabilecek bazı beceriler vermeyi amaçlıyorlar. "Makine ve insanın işbirliği yaptığı bir döngüye gerçekten ihtiyacınız var," diyor Barzilay.

ABD ordusu, vasıtaları ve uçakları kullanmak, hedefleri belirlemek ve analizcilere büyük istihbarat verisi yığınlarını elemelerinde yardımcı olmak için makine öğrenimini kullanacak olan projelere milyarlarca dolar döküyor. Burada, algoritmik gizem için diğer her yerden, hatta tıptan bile daha az yer bulunuyor ve ABD Savunma Bakanlığı, açıklanabilirlik konusunu kilit bir engel olarak tanımlıyor.

Savunma İleri Araştırma Projeleri Dairesi'nde (DARPA) program yöneticisi olan David Gunning, uygun şekilde adlandırılmış olan Açıklanabilir Yapay Zekâ programını idare ediyor. Önceden, nihayetinde Siri'nin oluşturulmasına öncülük eden DARPA projesini idare etmiş olan dairenin gümüş saçlı emektarı Gunning, otomasyonun ordunun sayısız alanına sızdığını söylüyor. İstihbarat analizcileri, çok büyük miktarlardaki istihbarat verisinde bulunan desenleri belirleme yolu olarak makine öğrenimini test ediyorlar. Birçok özerk kara aracı ve uçak geliştirilip test ediliyor. Fakat askerler, kendini onlara açıklamayan robotik bir tankın içinde muhtemelen rahat olmayacaklar ve analistler bazı gerekçeler olmadan bilgiye göre davranmakta isteksiz olacaklardır. Gunning şöyle söylüyor: "Bu makine öğrenim yapılarının doğasında sık sık yanlış alarm üretmek var, bu yüzden bir istihbarat analizcisi bir önerinin niçin yapıldığını anlamak konusunda gerçekten daha fazla yardıma ihtiyacı duyuyor."

DARPA, bu Mart ayında Gunning'in programı altında sermaye sağlamak amacıyla akademi ve sanayiden 13 tane proje seçti. Bunlardan bazıları, Washington Üniversitesi'nde profesör olan Carlos Guestrin'in önderlik ettiği çalışmanın üzerine inşa edilebilir. Kendisi ve meslektaşları, makine öğrenim yapılarının çıktıları için bir gerekçe sağlama yöntemi geliştirdiler. Aslen bir bilgisayar, bu yöntem altında bir veri dizisinden otomatik olarak birkaç örnek buluyor ve onları kısa bir açıklama ile sunuyor. Örneğin bir e-posta iletisini, bir teröristten gelen ileti şeklinde sınıflandırmak için tasarlanmış bir yapı, kendisine uygulanan eğitimde ve gerçekleştirdiği karar verme eyleminde milyonlarca iletiyi kullanabilir. Fakat Washington takımının yaklaşımını kullanarak, bir iletide bulunan belirli anahtar kelimeleri vurgulayabilir. Guestrin'in grubu ayrıca görüntü tanıma sistemlerinin gerekçelerine bakmak amacıyla, bir görüntünün en önemli kısımlarını vurgulayan bazı yöntemler tasarladılar.

Tıpkı Barzilay'ınkininki gibi, bu ve bunun gibi yaklaşımların bir engeli de, sağlanan açıklamaların her zaman basitleştirilmiş olacak olması, yani bazı hayati bilgilerin bu esnada kaybolacak olabilmesidir. "Yapay zekânın sizinle konuşabildiği ve açıklama yapabildiği hayalin tamamını henüz gerçekleştiremedik," diyor Guestrin. "Gerçekten anlaşılabilir olan yapay zekâdan uzaktayız."

Bunun bir mesele haline gelmesi için kanser teşhisi veya askerî taktikler gibi önemli sonuçları olan bir durum olması gerekmiyor. Eğer yapay zekâ günlük yaşamlarımızın yaygın ve yararlı bir parçası haline gelecekse, bu teknolojinin muhakemesini bilmek de çok önemli olacak. Apple'daki Siri takımına önderlik eden Tom Gruber, açıklanabilirliğin kendi takımı için kilit bir öneme sahip olduğunu çünkü Siri'yi daha akıllı ve daha yetenekli bir sanal yardımcı haline getirmeye çalıştıklarını söylüyor. Gruber, Siri'nin geleceği hakkındaki belirli planlarını söylemiyor, fakat eğer Siri'den bir lokanta önerisi alıyorsanız, sebebinin ne olduğunu bilmek isteyeceğinizi hayal etmek kolay. Apple'daki yapay zekâ araştırmasının yöneticisi ve Carnegie Mellon Üniversitesi'nde bir doçent olan Ruslan Salakhutdinov, açıklanabilirliği insanlar ile zeki makineler arasında evrimleşen ilişkinin çekirdeği olarak görüyor. "Bu güven sağlayacak," diyor.

İnsan davranışlarının sahip olduğu pek çok yönü detaylı şekilde açıklamanın imkansız olduğu gibi, belki de yapay zekâ için yaptığı her şeyi açıklamak da imkansız olacaktır. Wyoming Üniversitesi'nden Clune şöyle söylüyor: "Birisi, kendi eylemleri için size mantıklı gelen bir açıklama verebilse bile, bu muhtemelen eksik olur ve aynı durum yapay zekâ için de pekala doğru olabilir. Belki bu durum, sadece bir kısmı mantıklı izaha açık olan zekânın doğasının bir bölümü olabilir. Bunun bazı bölümleri sadece içgüdüseldir veya bilinçaltıdır veya anlaşılmazdır."

Eğer durum böyleyse, o halde bazı noktalarda sadece yapay zekânın hükmüne güvenmek zorunda kalabiliriz veya yaptığımız şeyi onu kullanmadan yaparız. Aynı şekilde, bu hükmün sosyal zekâ ile birleşmesi gerekecektir. Tıpkı toplumun beklenen bir davranış sözleşmesi üzerine inşa edilmiş olması gibi, yapay zekâ yapılarını kendi sosyal ölçütlerimize saygı gösterecek ve onlara uyacak şekilde tasarlamamız gerekecek. Eğer robot tanklar veya diğer öldürme makineleri üreteceksek, verdikleri kararların bizim ahlaki yargılarımız ile tutarlı olmaları önemlidir.

Bu metafiziksel kavramları irdelemek için Tufts Üniversitesi'nde bilinç ve zihin üzerinde çalışan ünlü bir düşünür ve algı bilimci olan Daniel Dennett'ın sözlerine kulak vermek yararlı olabilir. Dennett'in bilinç üzerine ansiklopedik bir bilimsel inceleme olan son kitabı Bakteriden Bekarlığa ve Geriye'deki bir bölüm, zekânın evriminin doğal bir parçasının, kendi yaratıcılarının nasıl yapıldığını bilmediği işleri yapabilen sistemlerin oluşumu olduğunu öne sürüyor. Dennet şöyle diyor: "Sorulması gereken soru, bunu akıllıca yapmak için hangi uzlaşmaları sağlamak zorundayız; onlardan ve kendimizden hangi ölçütleri talep ediyoruz?"

Kendisinin, açıklanabilirlik arayışı hakkında bir uyarısı da var. "Elbette bu şeyleri kullanacağımızı ve onlara güveneceğimizi düşünüyorum, o halde bize verdikleri cevapları nasıl ve neden verdiklerini mümkün olduğu kadar iyi şekilde anlayalım," diyor. Ancak ortada mükemmel bir cevap olmayabileceği için, birbirimizin olduğu kadar yapay zekânın açıklamaları hakkında da dikkatli olmalıyız; bir makine ne kadar zeki görünürse görünsün farketmez. "Eğer yaptığı şeyi açıklamada bizden daha iyi değilse," diyor, "o halde ona güvenmeyin."

Kaynak ve İleri Okuma

- Will Knight, MIT, "The Dark Secret at the Heart of AI" https://www.technologyreview.com/s/604087/the-dark-secret-at-the-heart-of-ai/

Etiket

Projelerimizde bize destek olmak ister misiniz?

Dilediğiniz miktarda aylık veya tek seferlik bağış yapabilirsiniz.

Destek Ol

Yorum Yap (0)

Bunlar da İlginizi Çekebilir

30 Mart 2016

Yapay Zekâların Yeni Mesleği: Yazarlık

23 Haziran 2015

Tüm Robotlar İçin Ortak Bir Beyin

05 Kasım 2018

Çevrelerini Algılayarak Karar Verebilen Robotlar

06 Ocak 2015

Video İzleyerek Yemek Yapmayı Öğrenen Robotlar

27 Haziran 2015

Yaşamın Anlamına İlişkin Fikir Yürüten Makine

28 Kasım 2015

Robotlar Her Emre Uymayacak

03 Ocak 2017

Kansere Karşı Savaşta, Yapay Zekâ: Nanodiskler