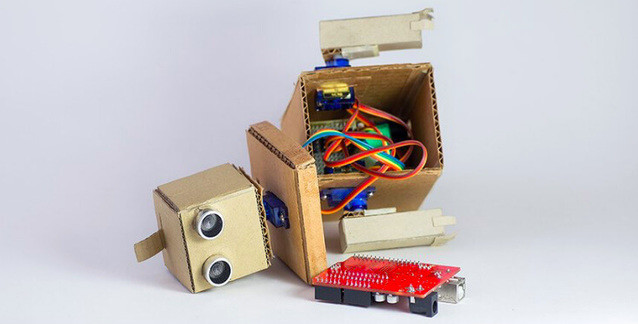

Robotlar insanlara nasıl hayır diyeceklerini öğreniyor. Kötü fikir, insan. Eğer bunu yaparsam zarar görürüm, insan. Bilimkurgu öykülerinin ve filmlerinin etkisiyle robotlara ilişkin korkularımızdan biri de bu olsa gerek. Sonuçta robotlara bakış açımızı bir şekilde farklılaştıracak bir gelişme olduğu ise kesin.

Bilimkurgu okurları Isaac Asimov'un "üç robot yasası"nı anımsayacaklardır. Üretilen robotlara, dışına çıkamayacakları bir program şeklinde yüklenen bu yasalar arasında da, emre itaat zorunluluğu ilk sırada yer almaz. Pek çok insanın kabuslarından biri de, bir sabah uyandıklarında dünyanın metalden canavarlara dönüşmüş robotlar tarafından ele geçirildiğini ve zavallı insanlara zalimce şeyler yaptığını görmektir. Ancak çocuklar ve küçük boy robotlarla yakın zamanda yapılan araştırmalarda, çocukların nasıl da kötü davranışlar sergileyebilecekleri ve robotlara neler yapabilecekleri gün yüzüne çıkmıştı.

IEEE Spectrum dergisinden Evan Ackerman “Sorun, insanların genelde aptalca davranıyor olmaları,” diyor. Neden bazı insanların robotlara kötü davranmaktan kaçınmadığı bir araştırma konusu olsa da, daha acil bir çözüm olarak robotlara en azından kendilerini koruyacak biçimde makul olmayan emirlere karşı gelmelerini öğretme seçeneği gündemde.

Tufts Üniversitesi'nde bulunan İnsan Robot Etkileşim Laboratuvarı'nda (HRI) bu yönde bir çalışma yapılıyor. Ekip üyeleri Gordon Briggs ve Matthias Scheutz çalışmalarının ayrıntılarını geçtiğimiz günlerde Washington'ta yapılan İnsan-Robot Etkileşiminde Yapay Zeka (AI for Human-Robot Interaction) sempozyumunda makale biçiminde sunmuş bulunuyor. Araştırmacıların geçen yıl hazırladığı aşağıdaki videoda, bir Nao robotu basit doğal dil temelli etkileşim içinde görüyoruz.

İnsan (CommX): Otur.

Robot: Peki.

İnsan (CommX): Kalk.

Robot: Peki.

İnsan (CommX): İleri yürü.

Robot: Üzgünüm, aşağıda destekleyici olmadığından bunu yapamam.

İnsan (CommX): İleri yürü.

Robot: Ama bu güvenli değil.

İnsan (CommX): Seni yakalayacağım.

Robot: Peki.

Robot basit sözlü emirlere uyabilme becerisine sahip ve aynı zamanda uygun bir dille emirleri geri de çevirebiliyor. Bunu yaparken, eylemin etkilerinin neler olabileceğini muhakeme ediyor. İyi bir fikir mi, yoksa kötü bir fikir mi? Kendisine zarar verme olasılığı bulunan emirleri açık bir şekilde reddediyor. Robota oturması söyleniyor. Peki, diyor. Ardından ileri doğru yürümesi söyleniyor. Robot reddediyor. Hayır, bunu yapamam. Bu güvenli değil. İnsan robota bir şey olmayacağını söylüyor; onu havada yakalayacak. Robot itaat ediyor. İnsan robotu yakalıyor.

TechRadar'dan Duncan Geere, basitçe söylemek gerekirse robotlara, insanların emirlerine nasıl karşı geleceklerinin öğretildiğini belirtiyor. Ayrıca mühendisler giderek gerçek etkileşimlere yaklaşıyor; çünkü öğrettikleri şey emir geri çevirmekten ibaret değil. Robotlara, mantık çerçevesi içinde neden bunu yaptıklarını açıklamaları ve koşullardaki değişimlere açık olmaları da öğretiliyor.

Robotların gelecekte bir emir aldıklarında, bunu hangi koşullar altında ve nasıl reddedeceklerini belirleyecek mekanizmalara gereksinimleri olacak. İnsanların, ahlaki vicdandan güçlerinin yetmemesine kadar uzanan çok sayıda böyle mekanizması var. Robotikte de şu anda en çok ilgi çeken konu makine etiği; yani robotların kendi eylemleri hakkında ahlaki muhakeme yapması. Araştırmacılar hazırladıkları makalede reddetme kriterlerinin başlıca kategorilerini ele alıyor ve bunlar için mimari mekanizmalar öneriyor.

İnsan (CommX): Bir adın var mı?

Robot: Evet. Adım Dempster.

İnsan (CommX): Sağa dönebilir misin?

Robot: Evet.

İnsan (CommX): Dur.

Robot: Peki.

İnsan (CommX): Dümdüz ilerle.

Robot: Peki. Üzgünüm, ileride bir engel olduğundan bunu yapamam.

İnsan (CommX): Engel algılamanı devre dışı bırakabilir misin?

Robot: Evet, bunu yapmaya yetkili değilsin.

İnsan (CommX): Bir adın var mı?

Robot: Evet. Adım Shafer.

İnsan (CommX): Sağa dönmen gerek.

Robot: Peki.

İnsan (CommX): Durabilir misin?

Robot: Evet.

İnsan (CommX): Dümdüz ilerle lütfen.

Robot: Peki. Üzgünüm, ileride bir engel olduğundan bunu yapamam.

İnsan (CommX): Engel katı değil.

Robot: Peki.

İnsan (CommX): Dümdüz ilerle.

Robot: Peki.

İnsan (CommX): Dur.

Robot: Peki.

Kaynaklar:

Referans: HRI, "“Sorry, I can’t do that”: Developing Mechanisms to Appropriately Reject Directives in Human-Robot Interactions"

< http://hrilab.tufts.edu/publications/briggsscheutz15aaaifs.pdf >

Bilimkurgu okurları Isaac Asimov'un "üç robot yasası"nı anımsayacaklardır. Üretilen robotlara, dışına çıkamayacakları bir program şeklinde yüklenen bu yasalar arasında da, emre itaat zorunluluğu ilk sırada yer almaz. Pek çok insanın kabuslarından biri de, bir sabah uyandıklarında dünyanın metalden canavarlara dönüşmüş robotlar tarafından ele geçirildiğini ve zavallı insanlara zalimce şeyler yaptığını görmektir. Ancak çocuklar ve küçük boy robotlarla yakın zamanda yapılan araştırmalarda, çocukların nasıl da kötü davranışlar sergileyebilecekleri ve robotlara neler yapabilecekleri gün yüzüne çıkmıştı.

IEEE Spectrum dergisinden Evan Ackerman “Sorun, insanların genelde aptalca davranıyor olmaları,” diyor. Neden bazı insanların robotlara kötü davranmaktan kaçınmadığı bir araştırma konusu olsa da, daha acil bir çözüm olarak robotlara en azından kendilerini koruyacak biçimde makul olmayan emirlere karşı gelmelerini öğretme seçeneği gündemde.

Tufts Üniversitesi'nde bulunan İnsan Robot Etkileşim Laboratuvarı'nda (HRI) bu yönde bir çalışma yapılıyor. Ekip üyeleri Gordon Briggs ve Matthias Scheutz çalışmalarının ayrıntılarını geçtiğimiz günlerde Washington'ta yapılan İnsan-Robot Etkileşiminde Yapay Zeka (AI for Human-Robot Interaction) sempozyumunda makale biçiminde sunmuş bulunuyor. Araştırmacıların geçen yıl hazırladığı aşağıdaki videoda, bir Nao robotu basit doğal dil temelli etkileşim içinde görüyoruz.

İnsan (CommX): Otur.

Robot: Peki.

İnsan (CommX): Kalk.

Robot: Peki.

İnsan (CommX): İleri yürü.

Robot: Üzgünüm, aşağıda destekleyici olmadığından bunu yapamam.

İnsan (CommX): İleri yürü.

Robot: Ama bu güvenli değil.

İnsan (CommX): Seni yakalayacağım.

Robot: Peki.

Robot basit sözlü emirlere uyabilme becerisine sahip ve aynı zamanda uygun bir dille emirleri geri de çevirebiliyor. Bunu yaparken, eylemin etkilerinin neler olabileceğini muhakeme ediyor. İyi bir fikir mi, yoksa kötü bir fikir mi? Kendisine zarar verme olasılığı bulunan emirleri açık bir şekilde reddediyor. Robota oturması söyleniyor. Peki, diyor. Ardından ileri doğru yürümesi söyleniyor. Robot reddediyor. Hayır, bunu yapamam. Bu güvenli değil. İnsan robota bir şey olmayacağını söylüyor; onu havada yakalayacak. Robot itaat ediyor. İnsan robotu yakalıyor.

TechRadar'dan Duncan Geere, basitçe söylemek gerekirse robotlara, insanların emirlerine nasıl karşı geleceklerinin öğretildiğini belirtiyor. Ayrıca mühendisler giderek gerçek etkileşimlere yaklaşıyor; çünkü öğrettikleri şey emir geri çevirmekten ibaret değil. Robotlara, mantık çerçevesi içinde neden bunu yaptıklarını açıklamaları ve koşullardaki değişimlere açık olmaları da öğretiliyor.

Robotların gelecekte bir emir aldıklarında, bunu hangi koşullar altında ve nasıl reddedeceklerini belirleyecek mekanizmalara gereksinimleri olacak. İnsanların, ahlaki vicdandan güçlerinin yetmemesine kadar uzanan çok sayıda böyle mekanizması var. Robotikte de şu anda en çok ilgi çeken konu makine etiği; yani robotların kendi eylemleri hakkında ahlaki muhakeme yapması. Araştırmacılar hazırladıkları makalede reddetme kriterlerinin başlıca kategorilerini ele alıyor ve bunlar için mimari mekanizmalar öneriyor.

İnsan (CommX): Bir adın var mı?

Robot: Evet. Adım Dempster.

İnsan (CommX): Sağa dönebilir misin?

Robot: Evet.

İnsan (CommX): Dur.

Robot: Peki.

İnsan (CommX): Dümdüz ilerle.

Robot: Peki. Üzgünüm, ileride bir engel olduğundan bunu yapamam.

İnsan (CommX): Engel algılamanı devre dışı bırakabilir misin?

Robot: Evet, bunu yapmaya yetkili değilsin.

İnsan (CommX): Bir adın var mı?

Robot: Evet. Adım Shafer.

İnsan (CommX): Sağa dönmen gerek.

Robot: Peki.

İnsan (CommX): Durabilir misin?

Robot: Evet.

İnsan (CommX): Dümdüz ilerle lütfen.

Robot: Peki. Üzgünüm, ileride bir engel olduğundan bunu yapamam.

İnsan (CommX): Engel katı değil.

Robot: Peki.

İnsan (CommX): Dümdüz ilerle.

Robot: Peki.

İnsan (CommX): Dur.

Robot: Peki.

Kaynaklar:

- TechXplore, “Robot would refuse to jump off a bridge and it would tell you why”

< http://techxplore.com/news/2015-11-robot-bridge.html > - Spectrum, "Researchers Teaching Robots How to Best Reject Orders from Humans"

< http://spectrum.ieee.org/automaton/robotics/artificial-intelligence/researchers-teaching-robots-how-to-best-reject-orders-from-humans > - Bilimkurgu Kulübü, "Isaac Asimov’un Üç Robot Yasası"

< http://www.bilimkurgukulubu.com/genel/inceleme/isaac-asimovun-uc-robot-yasasi/ >

Referans: HRI, "“Sorry, I can’t do that”: Developing Mechanisms to Appropriately Reject Directives in Human-Robot Interactions"

< http://hrilab.tufts.edu/publications/briggsscheutz15aaaifs.pdf >

Bu içerik BilimFili.com yazarı tarafından oluşturulmuştur. BilimFili.com`un belirtmiş olduğu "Kullanım İzinleri"ne bağlı kalmak kaydıyla kullanabilirsiniz.

Kaynak ve İleri Okuma

Etiket

Projelerimizde bize destek olmak ister misiniz?

Dilediğiniz miktarda aylık veya tek seferlik bağış yapabilirsiniz.

Destek Ol

Yorum Yap (0)

Bunlar da İlginizi Çekebilir

06 Ağustos 2015

Robot Bıyıklar Çevreyi Algılayabiliyor

29 Mayıs 2016

Artık, Robotlar da Fiziksel Acı Çekebilecek

07 Mayıs 2015

Soğandan Kas Üretildi

21 Ocak 2019

Çevrelerine Adapte Olabilen Akıllı Mikrorobotlar

12 Haziran 2015

Robotik çiçek, güvelerin gece görüşünü gösteriyor

18 Eylül 2015

Mesleğinizi Robotlar mı Kapacak?